上周,月之暗面發(fā)布了全新版本的大模型,Kimi K2。

這是目前世界上第一個(gè)參數(shù)量達(dá)到萬(wàn)億級(jí)別的開(kāi)源模型,發(fā)布后迅速引爆了圈內(nèi)討論。

它不僅在各種評(píng)估基準(zhǔn)上表現(xiàn)亮眼,也收獲了國(guó)內(nèi)外開(kāi)發(fā)者社區(qū)的普遍好評(píng)。

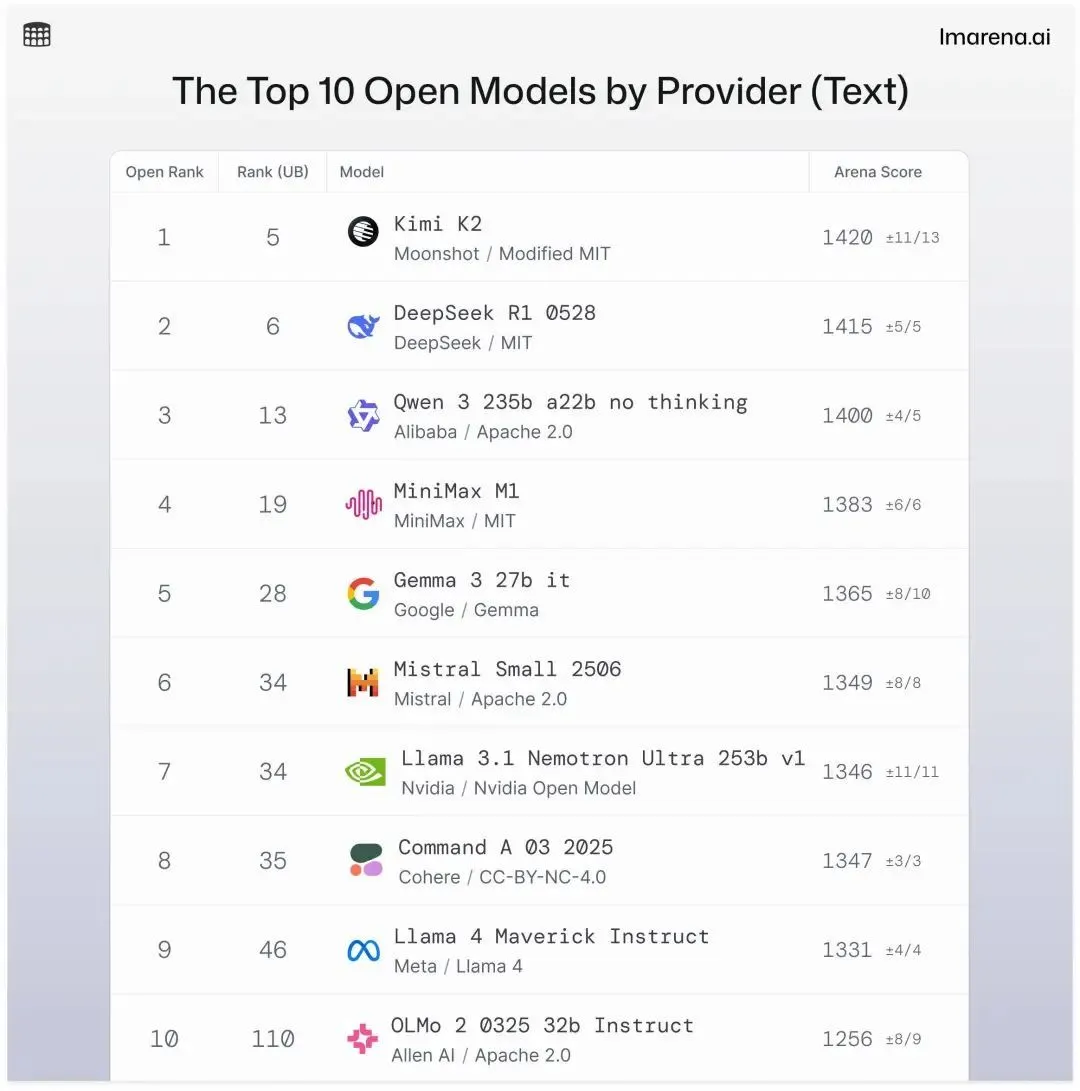

在 LMSYS 的開(kāi)源模型排行榜(LMArena)上,Kimi K2 直接躍升至第一名。

第一列是開(kāi)源模型內(nèi)的排名,前四都是國(guó)產(chǎn)開(kāi)源模型,Kimi K2 排在第一名;第二列是所有(開(kāi)源和閉源)模型中的排名。圖片來(lái)源:https://lmarena.ai/leaderboard/text

但也有不少人質(zhì)疑 Kimi K2 是在「抄襲」DeepSeek。

Kimi 團(tuán)隊(duì)則大方回應(yīng):確實(shí)是在 DeepSeek V3 的基礎(chǔ)上做了改進(jìn)。

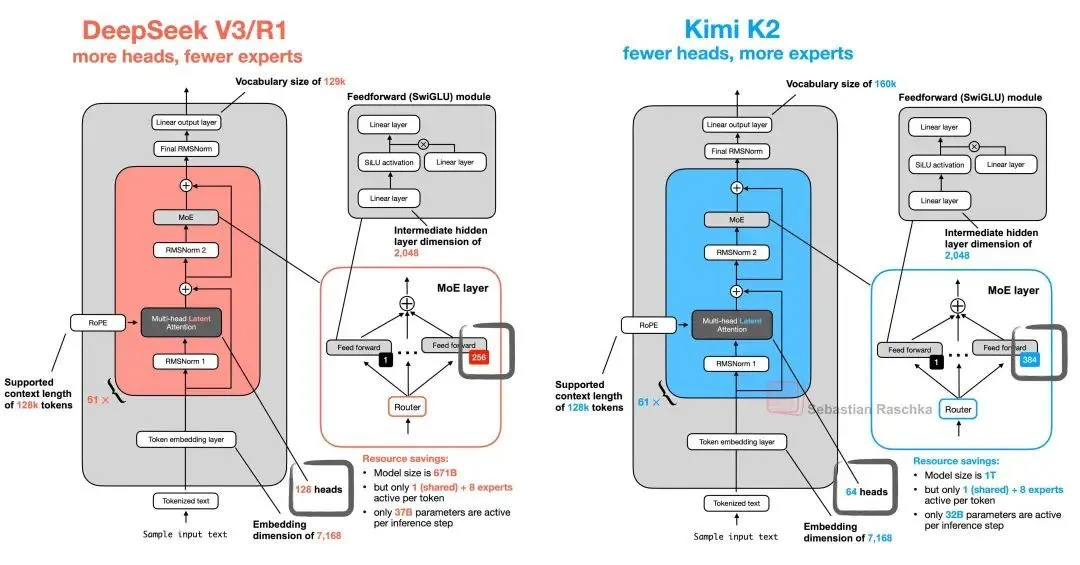

甚至有網(wǎng)友直接對(duì)比了兩者的架構(gòu),指出了細(xì)節(jié)差異:

Kimi K2 發(fā)布后,網(wǎng)友整理 DeepSeek V3 和 Kimi K2 的模型架構(gòu)區(qū)別,來(lái)源:https://sebastianraschka.com/blog/2025/the-big-llm-architecture-comparison

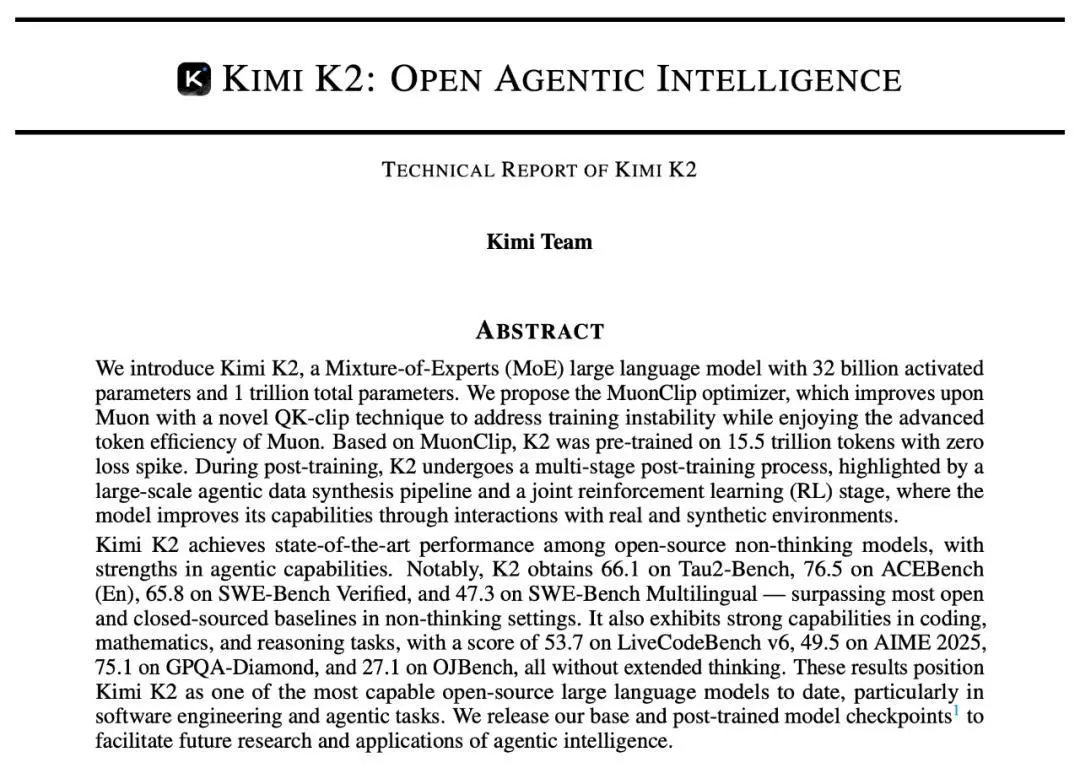

就在大家還在討論這些差異、參數(shù)規(guī)模、以及模型路線時(shí),Kimi 今天又放出了一份干貨:Kimi K2 的技術(shù)報(bào)告正式發(fā)布。

我第一時(shí)間打開(kāi)來(lái)看,快速掃了一遍,關(guān)鍵詞大概是:萬(wàn)億參數(shù)的混合專家模型、讓訓(xùn)練更穩(wěn)定的 MuonClip 優(yōu)化器、不斷被強(qiáng)調(diào)的 Agentic 智能,還有自我批評(píng)式的通用強(qiáng)化學(xué)習(xí)……

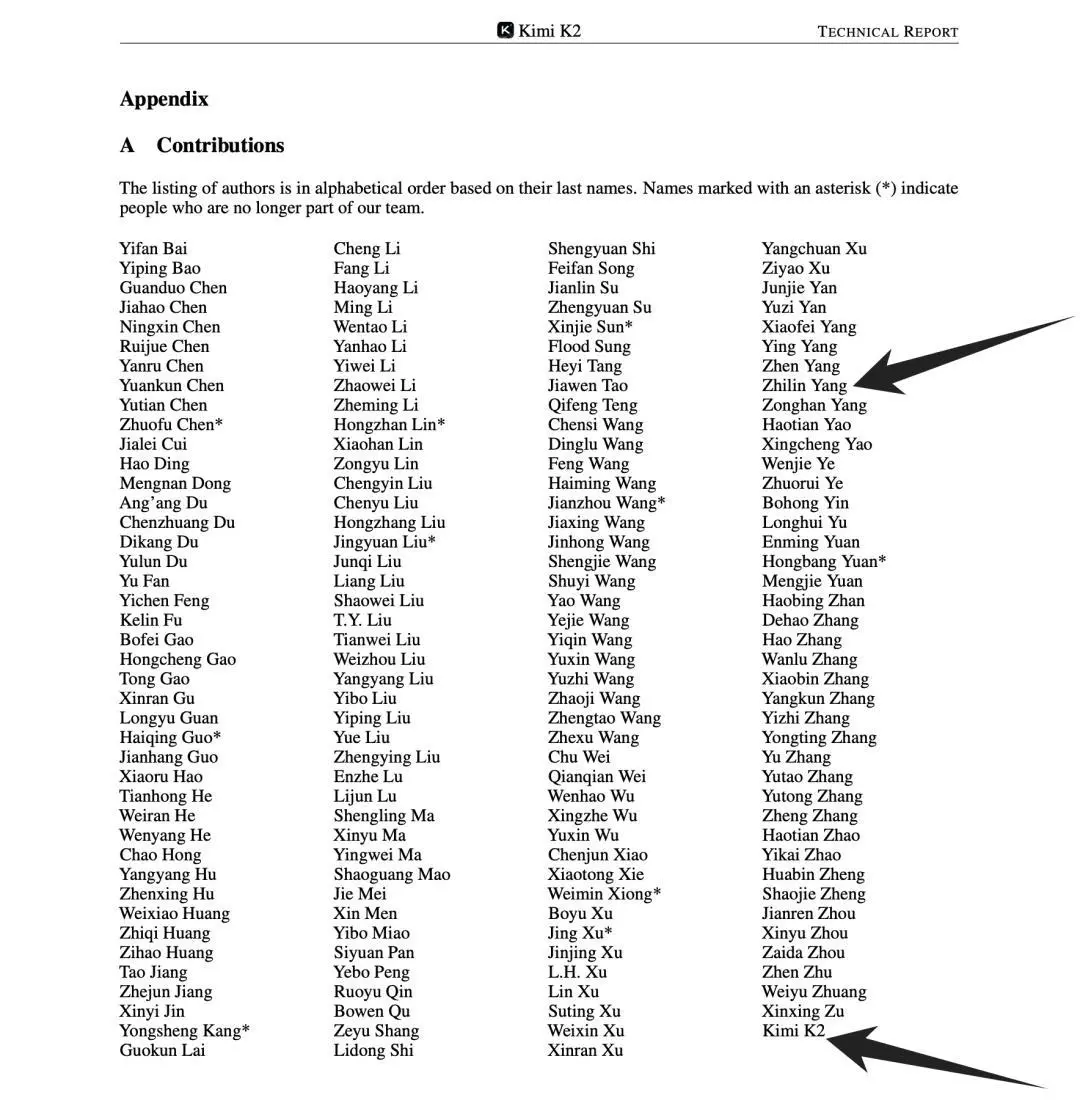

直到我翻到附錄,發(fā)現(xiàn)一張有點(diǎn)意思的作者列表,除了看到月之暗面創(chuàng)始人楊植麟的名字,竟然!

Kimi K2 技術(shù)報(bào)告作者頁(yè)面

Kimi K2……自己也是作者之一?

我突然有點(diǎn)恍惚,把你「造」出來(lái),你還參與了如何「造出你」的論文撰寫(xiě)?

那我還研究什么,既然它都上作者署名了,直接問(wèn)他就好了!

我就把這份技術(shù)報(bào)告交給 Kimi K2 來(lái)分析一下,看看它能不能講明白,Kimi K2 到底做了什么。

于是,這篇文章就變成了:我,把技術(shù)報(bào)告丟給了 Kimi K2,讓它「揭秘」它自己。

Kimi K2:為「智能體時(shí)代」奠基的萬(wàn)億級(jí)開(kāi)源大模型——《Kimi K2 Technical Report》深度解讀

從「會(huì)聊天」到「能干活」:為什么需要新一代大模型

過(guò)去兩年,大模型的競(jìng)賽焦點(diǎn)集中在「誰(shuí)能把考試題刷得更高」,但真實(shí)世界的需求正在迅速轉(zhuǎn)向「誰(shuí)能像人一樣干活」。

從自動(dòng)修復(fù)代碼漏洞、跨工具協(xié)同辦公,到自主完成科研實(shí)驗(yàn),業(yè)界把這種「感知-規(guī)劃-執(zhí)行-反思」的閉環(huán)能力稱為 Agentic Intelligence(智能體智能)。

Kimi K2 正是這種范式切換下的第一個(gè)系統(tǒng)性成果:它不僅要會(huì)做題,更要能在復(fù)雜、動(dòng)態(tài)、多工具環(huán)境中像「實(shí)習(xí)生」一樣自我進(jìn)化。

速看省流版:

技術(shù)層面:MuonClip 優(yōu)化器、稀疏 MoE 架構(gòu)、改寫(xiě)數(shù)據(jù)策略,共同給出了「高質(zhì)量數(shù)據(jù)稀缺」時(shí)代的超大規(guī)模訓(xùn)練新范式;

數(shù)據(jù)層面:合成+真實(shí)混合環(huán)境的十萬(wàn)個(gè)工具軌跡為社區(qū)提供了可復(fù)現(xiàn)、可擴(kuò)展的智能體數(shù)據(jù)生產(chǎn)線;

開(kāi)源層面:1 T 參數(shù)的 base + instruct 權(quán)重全部放出,相當(dāng)于把一輛 F1 賽車開(kāi)源給了所有工程師。

模型一覽:萬(wàn)億總參數(shù)、320 億激活的「稀疏巨人」

規(guī)模:總參數(shù) 1.04 T,激活參數(shù) 32 B,MoE(混合專家)架構(gòu),稀疏度 48(每 token 只激活 8/384 位專家);DeepSeek V3 的參數(shù)總量是 6710 億,其中激活參數(shù)量為370 億 。

訓(xùn)練數(shù)據(jù):15.5 T token,涵蓋網(wǎng)頁(yè)、代碼、數(shù)學(xué)、知識(shí)四大領(lǐng)域,全部經(jīng)過(guò)質(zhì)量清洗與「改寫(xiě)法(數(shù)據(jù)增強(qiáng)技術(shù),增加數(shù)據(jù)多樣性)」擴(kuò)增。

訓(xùn)練穩(wěn)定:首次在大規(guī)模模型訓(xùn)練過(guò)程中,損失函數(shù)沒(méi)有發(fā)生任何大的波動(dòng)或異常,歸功于新優(yōu)化器 MuonClip。

上下文窗口:128K token,滿足長(zhǎng)文檔、多輪工具調(diào)用的需求。

MuonClip:大規(guī)模模型超高效訓(xùn)練方法

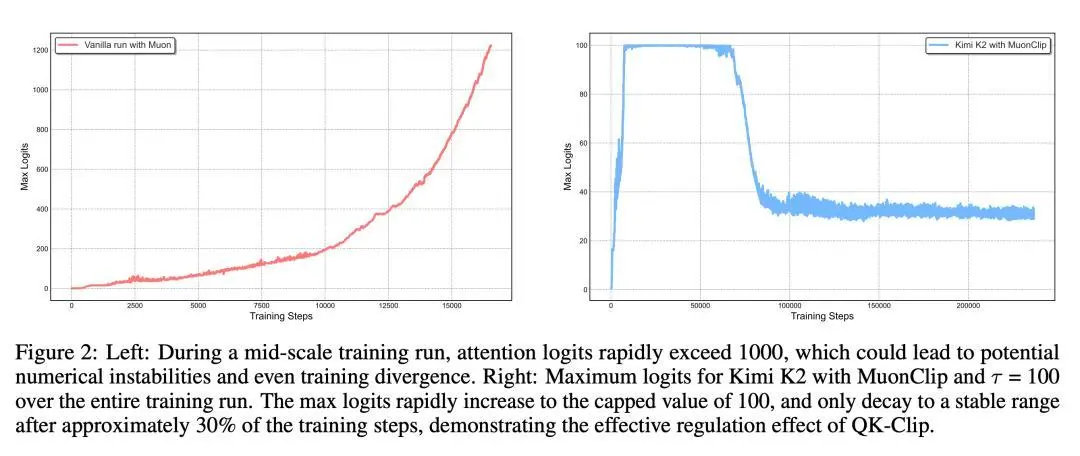

Muon 優(yōu)化器以訓(xùn)練效率高著稱,但在參數(shù)規(guī)模較大時(shí),可能會(huì)出現(xiàn)注意力權(quán)重爆炸的問(wèn)題,即 logits 值過(guò)大,導(dǎo)致訓(xùn)練不穩(wěn)定。

作者提出 QK-Clip 機(jī)制融合到 Muon 優(yōu)化器中。QK-Clip 能夠在 logit 過(guò)大時(shí),自動(dòng)進(jìn)行調(diào)節(jié);同時(shí),不會(huì)改變網(wǎng)絡(luò)結(jié)構(gòu),對(duì)模型干預(yù)極小,但作用極大。

注意力權(quán)重爆炸問(wèn)題大多出現(xiàn)在超大規(guī)模的大模型訓(xùn)練中,這也是此次 Kimi K2 萬(wàn)億參數(shù)能夠成功訓(xùn)練的重要突破之一。

沒(méi)有使用 QK-Clip 的 Muon 優(yōu)化器在訓(xùn)練時(shí),會(huì)無(wú)法控制 logits 數(shù)值,從而導(dǎo)致大模型訓(xùn)練的不穩(wěn)定;而 Kimi K2 的 MuonClip 在整個(gè)訓(xùn)練過(guò)程中都可以很好的控制 logits 。

實(shí)驗(yàn)顯示,MuonClip 在中等規(guī)模,90 億激活參數(shù)時(shí),就可抑制 logits 超過(guò) 1000,在 K2 全量訓(xùn)練中全程沒(méi)有不穩(wěn)定和優(yōu)化問(wèn)題出現(xiàn),始終確保了訓(xùn)練的穩(wěn)定性。

文本數(shù)據(jù):合成數(shù)據(jù)+真實(shí)數(shù)據(jù)雙 buff

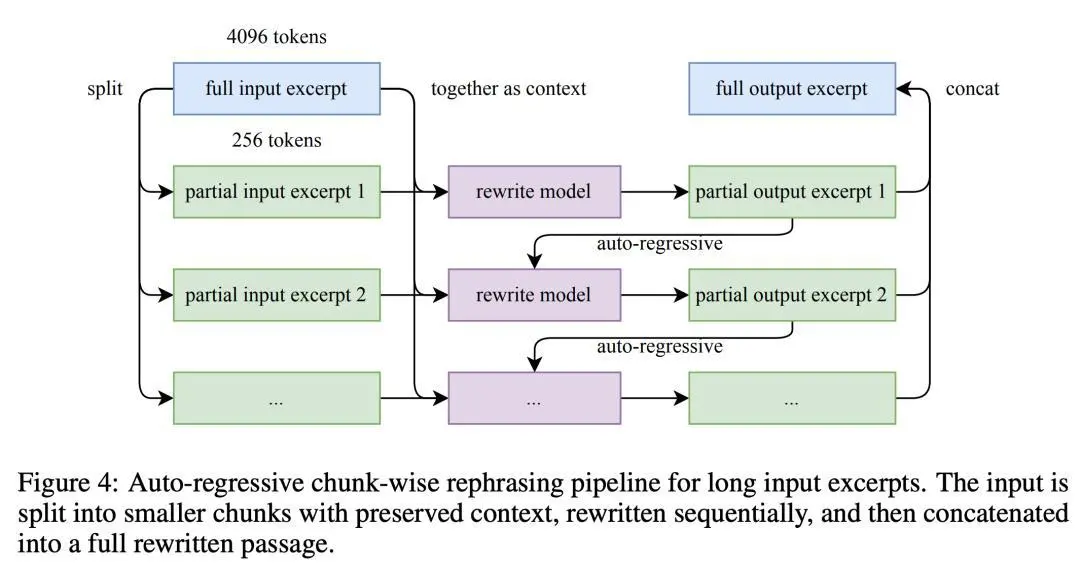

高質(zhì)量數(shù)據(jù)越來(lái)越稀缺,而在訓(xùn)練中簡(jiǎn)單多輪重復(fù)讀取容易導(dǎo)致模型的過(guò)擬合。Kimi K2 提出兩套改寫(xiě)策略:

知識(shí)文本:用 LLM 以不同風(fēng)格、視角重寫(xiě)維基百科,同時(shí)保持語(yǔ)義一致性自動(dòng)校驗(yàn),例如把「光合作用」改寫(xiě)成「植物如何制造養(yǎng)分的偵探故事」;

數(shù)學(xué)文本:按「學(xué)習(xí)筆記」風(fēng)格重寫(xiě)并多語(yǔ)種翻譯,把奧數(shù)競(jìng)賽題都改寫(xiě)成「費(fèi)曼式講解」。

數(shù)據(jù)改寫(xiě)流程,將輸入拆分為保留上下文的小塊,按順序重寫(xiě),然后拼接成完整的重寫(xiě)段落。

Kimi K2 也在多個(gè)實(shí)驗(yàn)進(jìn)行了測(cè)試,結(jié)果顯示一次改寫(xiě)+單輪訓(xùn)練的準(zhǔn)確率(28.94%)優(yōu)于原始文本反復(fù)讀取十輪(23.76%)。

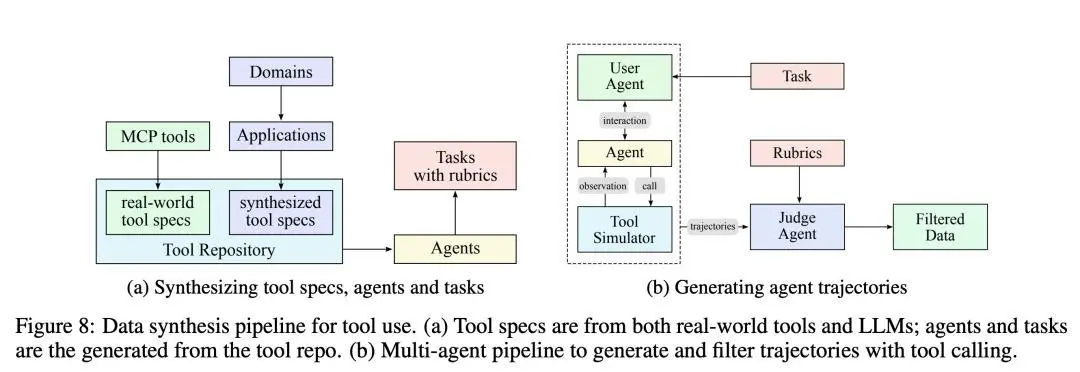

智能體數(shù)據(jù):2 萬(wàn)工具、10 萬(wàn)軌跡

要讓模型會(huì)調(diào)用工具,最難的是「可擴(kuò)展的真實(shí)環(huán)境」。作者搭建了混合管線:

工具庫(kù):3000+ 真實(shí) MCP 工具,2 萬(wàn)+ LLM 合成工具,覆蓋金融、城市物聯(lián)網(wǎng)、軟件開(kāi)發(fā)等 20 余領(lǐng)域;

「任務(wù)-智能體-評(píng)估」三元組自動(dòng)生成智能體訓(xùn)練樣本:每條生成的軌跡(即模型的輸入、輸出、決策過(guò)程、以及所采取的每一步行動(dòng))由 LLM Judge 打分,通過(guò)率 <10% 時(shí),采用拒絕采樣方法;確保只選擇符合要求的樣本進(jìn)行進(jìn)一步的訓(xùn)練或評(píng)估;

真實(shí)智能體任務(wù)數(shù)據(jù)補(bǔ)充:例如代碼類任務(wù)直接扔給開(kāi)源的容器編排平臺(tái),執(zhí)行任務(wù)并測(cè)試,保證反饋真實(shí)。

工具庫(kù)使用的數(shù)據(jù)合成流程,工具來(lái)自真實(shí)世界的工具和LLMs;智能和任務(wù)從工具庫(kù)中生成。

最終產(chǎn)出超過(guò) 10 萬(wàn)的高質(zhì)量軌跡,用于監(jiān)督微調(diào)與強(qiáng)化學(xué)習(xí)。

強(qiáng)化學(xué)習(xí)框架:可驗(yàn)證獎(jiǎng)勵(lì) + 自我批評(píng)

可驗(yàn)證獎(jiǎng)勵(lì)的強(qiáng)化學(xué)習(xí):對(duì)于數(shù)學(xué)、代碼、邏輯題等任務(wù),直接跑單元測(cè)試或數(shù)值驗(yàn)證,客觀評(píng)估模型表現(xiàn);

自我批評(píng)獎(jiǎng)勵(lì):而對(duì)于非客觀任務(wù)(比如寫(xiě)詩(shī)等),模型用 30 多條標(biāo)準(zhǔn)(清晰、客觀、對(duì)話流暢、安全等指標(biāo))給 Kimi K2 的回答打分,實(shí)現(xiàn)無(wú)參考答案的對(duì)齊;

預(yù)算控制:拒絕「廢話連篇」,強(qiáng)制用最少 token 解決問(wèn)題(節(jié)省推理費(fèi))。

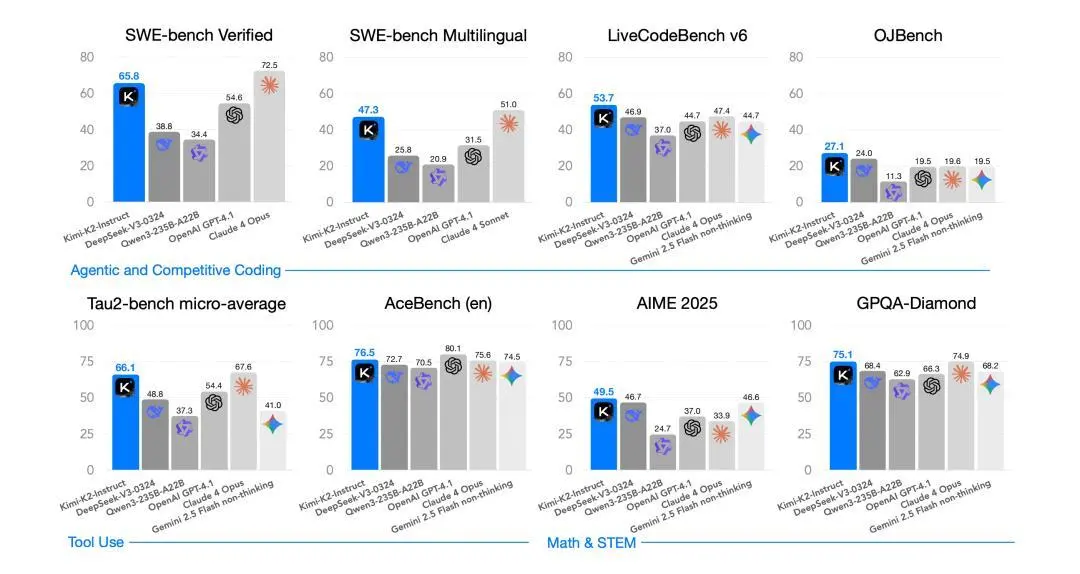

成績(jī)匯報(bào):開(kāi)源第一,逼近閉源

所有對(duì)比均為「非思考」模式,不考慮測(cè)試時(shí)計(jì)算資源的差異。

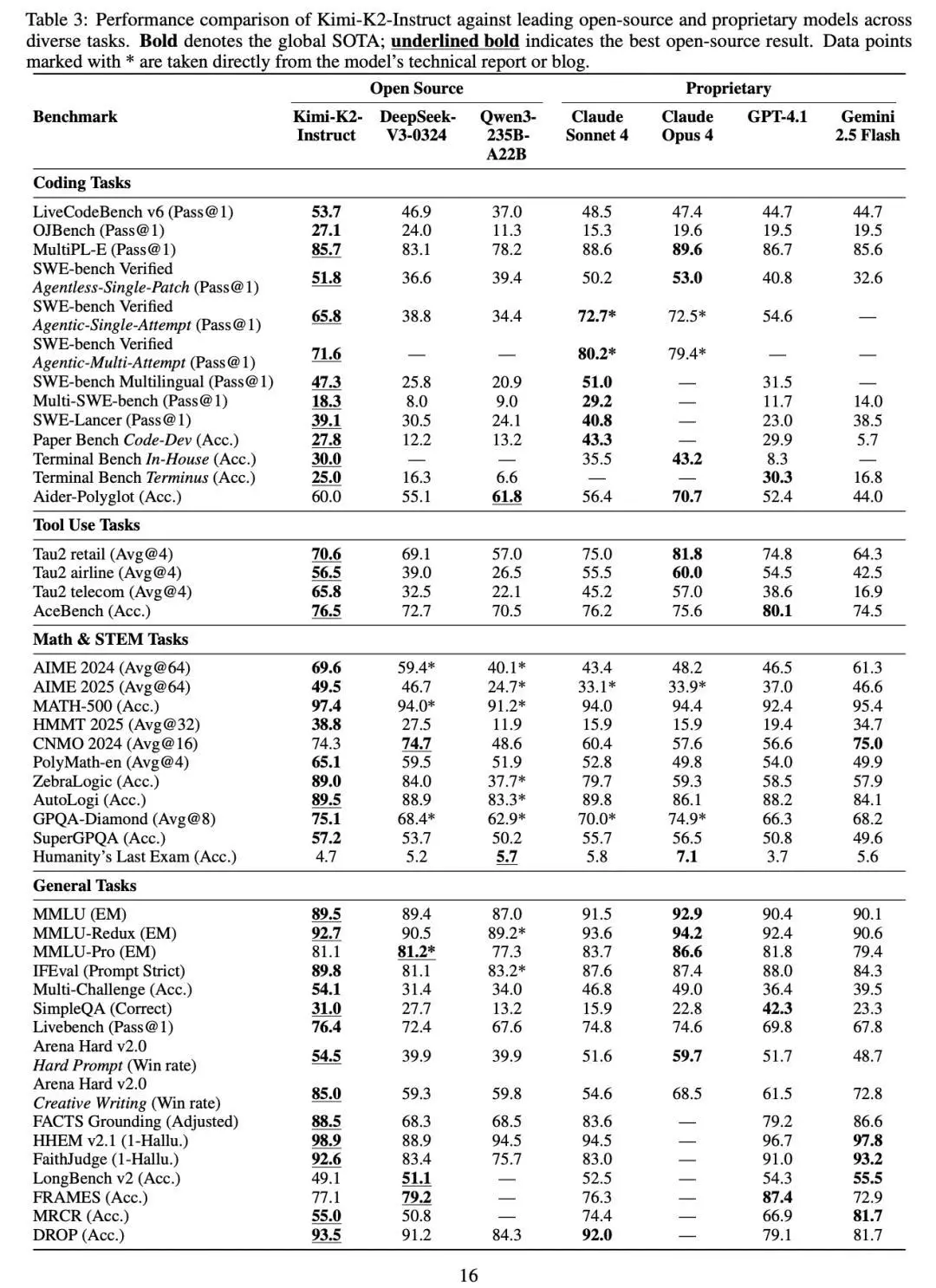

Kimi K2 在代碼、數(shù)學(xué)、工具使用和長(zhǎng)文本四項(xiàng)關(guān)鍵能力上均取得或逼近當(dāng)前開(kāi)源模型的最優(yōu)成績(jī),并在多項(xiàng)任務(wù)上超越閉源標(biāo)桿。

詳細(xì)結(jié)果圖,從上至下依次是代碼、工具、理工科以及通用任務(wù)。

局限與展望

多步復(fù)雜推理場(chǎng)景下輸出過(guò)長(zhǎng),可能被截?cái)啵?/p>

在多輪任務(wù)中,如果觸發(fā)了錯(cuò)誤工具,或者工具調(diào)用失敗,會(huì)拉低表現(xiàn);

Kimi K2,是「Agentic-aware」模型(接受過(guò) agent 任務(wù)訓(xùn)練),但還不是一個(gè)「完整 Agent 框架」系統(tǒng)。在長(zhǎng)流程開(kāi)發(fā)任務(wù)中的一次成功率,Kimi K2 仍然低于那些完整 Agent 框架驅(qū)動(dòng)下的系統(tǒng)。

Kimi K2 后續(xù)將圍繞推理效率、工具自我評(píng)估、長(zhǎng)過(guò)程推理規(guī)劃繼續(xù)迭代。

Kimi K2 的意義不止于又刷新了幾個(gè) benchmark。可以預(yù)料,隨著開(kāi)源社區(qū)在此基礎(chǔ)上繼續(xù)改進(jìn),2025 下半年將出現(xiàn)一批「比 K2 更會(huì)干活」的垂直智能體,真正把大模型從「聊天框」帶進(jìn)「生產(chǎn)線」。