4B模型的數(shù)學推理能力和頂尖商業(yè)大模型差在哪里?

香港大學NLP團隊聯(lián)合字節(jié)跳動Seed、復旦大學發(fā)布名為Polaris的強化學習訓練配方:

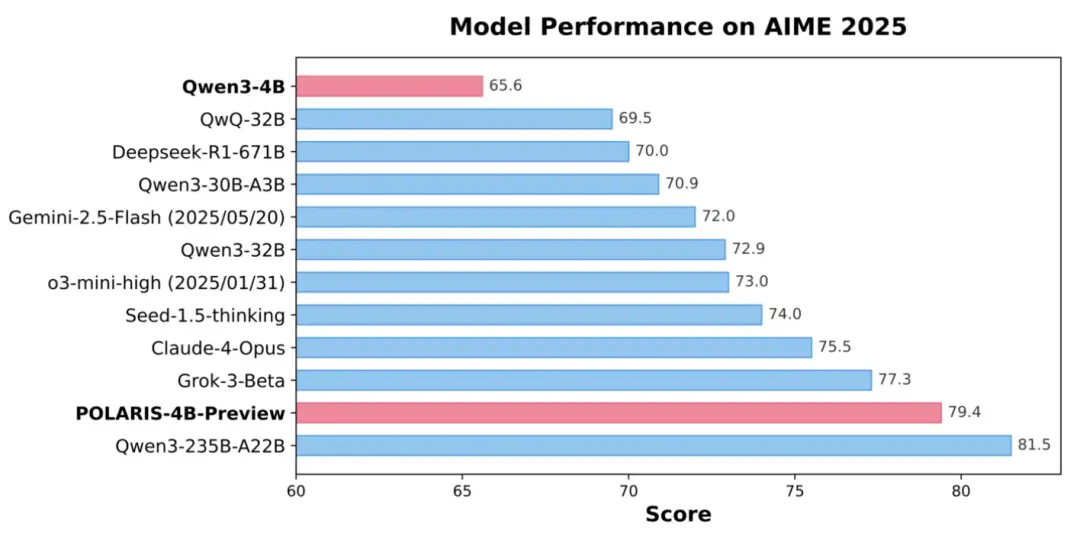

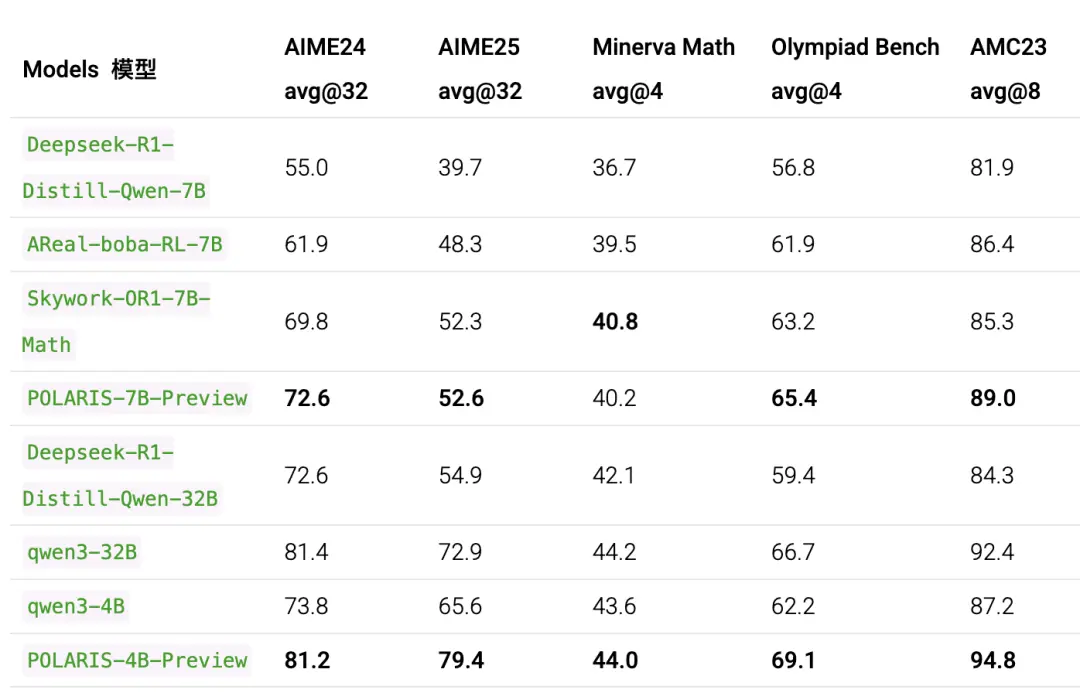

通過Scaling RL,Polaris讓4B模型的數(shù)學推理能力(AIME25上取得79.4,AIME24上取得81.2)超越了一眾商業(yè)大模型,如Seed-1.5-thinking、Claude-4-Opus和o3-mini-high(25/01/31)。

并且,Polaris-4B的輕量化允許在消費級顯卡上部署。

詳細的blog、訓練數(shù)據(jù)、模型和代碼都已全部開源,鏈接可見文末。

圍繞待訓練模型進行參數(shù)配置

之前的RL訓練配方,如DeepScaleR,已經(jīng)展示了Scaling RL在較弱基模型上強大的效果。

但對于目前最前沿的開源模型(如Qwen3),Scaling RL是否也能復現(xiàn)如此顯著的提升呢?

Polaris的研究團隊給出了明確回答:可以!

具體來說,Polaris通過僅僅700步的RL訓練,成功地讓Qwen3-4B在數(shù)學推理任務上接近了其235B版本的表現(xiàn)。

只要方法得當,RL還存在著巨大的開發(fā)潛力。

Polaris的成功的秘籍就是:訓練數(shù)據(jù)及超參數(shù)設置都要圍繞待訓練的模型來進行設置。

訓練數(shù)據(jù)構造

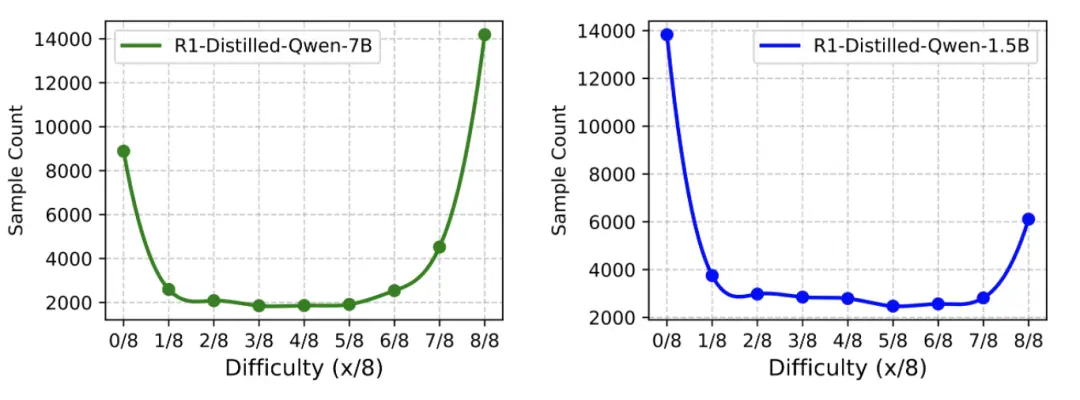

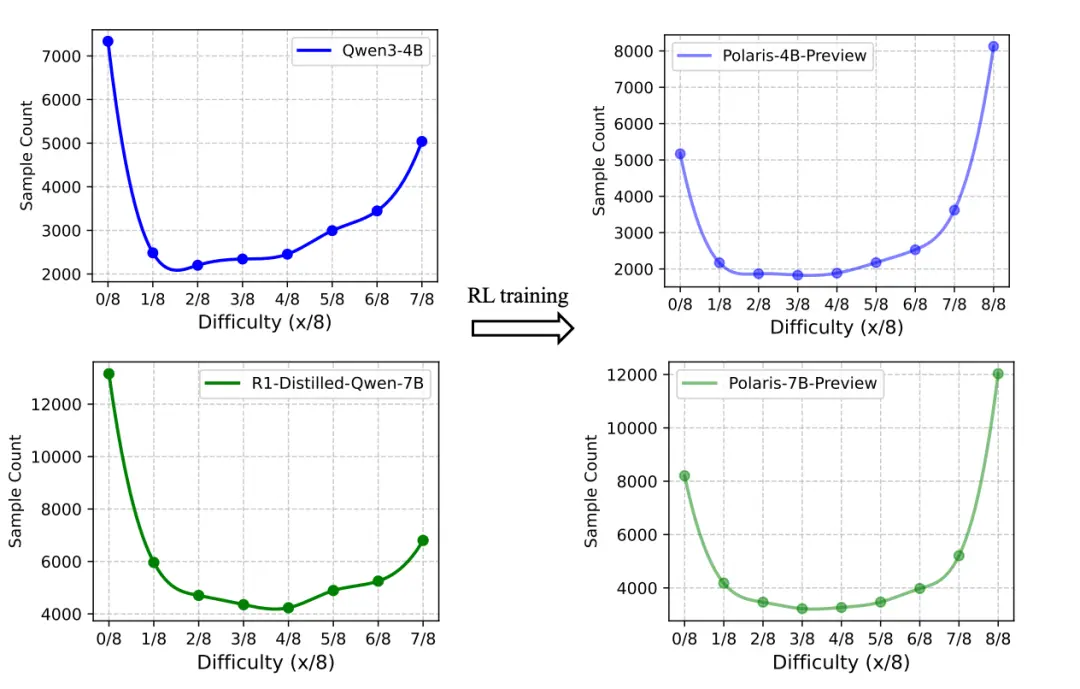

Polaris團隊發(fā)現(xiàn),對于同一份數(shù)據(jù),不同能力的基模型展現(xiàn)出的難度分布呈現(xiàn)出鏡像化的特征。、

對于DeepScaleR-40K訓練集中的每個樣本,研究人員使用R1-Distill-Qwen-1.5B/7B兩個模型回答分別推理了8次,再統(tǒng)計其中正確次數(shù),以此衡量每個樣本的難度水平。

實驗結果顯示,大多數(shù)樣本位于兩端(8/8正確解答或0/8正確解答),意味著該數(shù)據(jù)集雖然對1.5B模型具有挑戰(zhàn)性,卻不足以有效訓練7B模型。

Polaris提出,構建輕微偏向難題的數(shù)據(jù)分布,形狀就像鏡像J,過度偏向簡單題或難題的分布都會使得無法產(chǎn)生優(yōu)勢的樣本在每個batch中占有過大的比例。

Polaris對開源數(shù)據(jù)DeepScale-40K和AReaL-boba-106k進行了篩選,剔除所有8/8正確的樣本,最終形成了53K的初始化數(shù)據(jù)集。

盡管已經(jīng)得到了一個好的初始化數(shù)據(jù),但它并不是訓練數(shù)據(jù)的“最終版本”。

在強化學習訓練過程中,隨著模型對訓練樣本的“掌握率”提高,難題也會變成簡單題。

為此,研究團隊在訓練中引入了數(shù)據(jù)動態(tài)更新策略。訓練過程中,每個樣本的通過率會隨著reward計算而實時更新。在每個訓練階段結束時,準確率過高的樣本將被刪除。

以多樣性為核心的采樣控制

在RL訓練中,多樣性被視為提升模型表現(xiàn)的重要因素。好的多樣性使模型能探索更廣泛的推理路徑,避免在訓練早期陷入過于確定的策略中。

Rollout階段的多樣性主要通過topp、topk與溫度t來調控。當前大多數(shù)工作都采用topp=1.0和topk=-1,這已經(jīng)達到了最大的多樣性,但采樣溫度t還沒有統(tǒng)一的設置。

目前主流的t的設置方法有兩種:1、采用建議的解碼溫度,如Qwen3 demo中設置的0.6;2、直接設置為一個整數(shù)1.0。

但這兩種做法在Polaris的實驗中都不是最優(yōu)解。

溫度、性能與多樣性的平衡之道

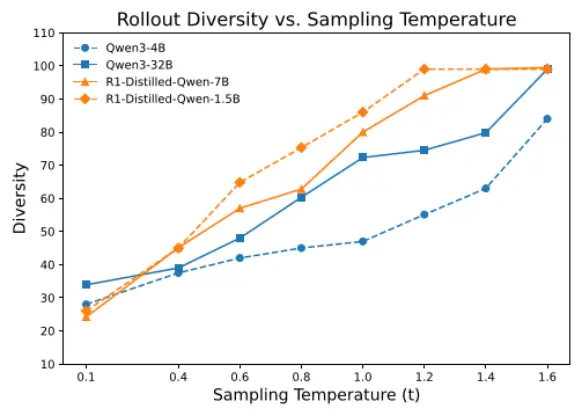

Polaris團隊通過一系列試驗,分析了采樣溫度與模型準確率及路徑多樣性之間的關系。

為了量化采樣軌跡的多樣性,他們采用Distinct N-gram指標(n=4)用于衡量生成文本中獨特連續(xù)詞組的比例:分數(shù)越接近1.0,說明生成內容越多樣;反之則重復率較高。

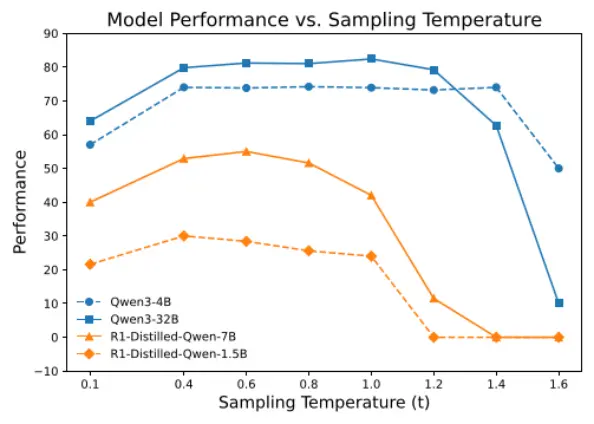

結果顯示,較高的溫度能顯著提升多樣性,但不同模型在相同溫度下的表現(xiàn)也存在較大差異。從上圖來看,對于這兩個模型來說,以0.6作為采樣溫度明顯多樣性是不足的。

但也并非是把溫度設的越大就越好,也需要考慮性能的變化。

Polaris團隊發(fā)現(xiàn)模型性能隨溫度升高呈現(xiàn)“低-高-低”的趨勢。例如,把采樣溫度設置成1.0,對于Deepseek-R1-distill系列模型過高了,而對于Qwen3系列來說又有點低。

說明理想溫度的設計需要針對待模型進行精細校準,沒有一個超參數(shù)是適配所有模型的。

溫度區(qū)間的定義

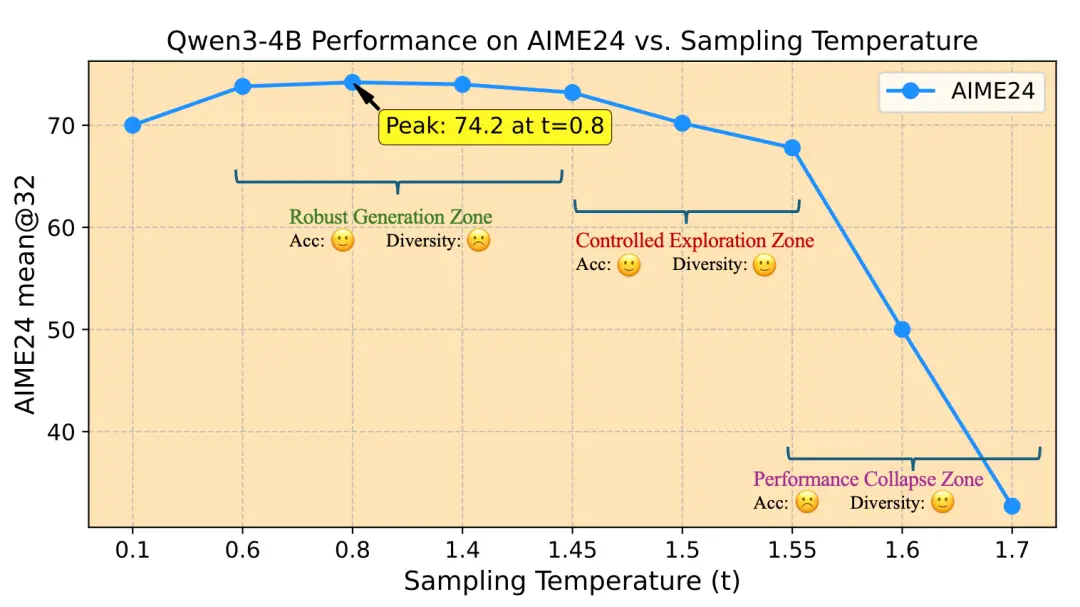

Polaris團隊基于實驗趨勢歸納出模型采樣溫度的三個區(qū)域:

1.魯棒生成區(qū)(Robust Generation Zone)

在該區(qū)域內,性能波動較小。測試階段解碼溫度通常就選自魯棒生成區(qū)。

2.控制探索區(qū)(Controlled Exploration Zone)

此區(qū)域的溫度雖然會導致模型性能較魯棒生成區(qū)略有下降,但降幅在可接受范圍內,同時能顯著提升多樣性,適合作為訓練溫度使用。

3.性能崩塌區(qū)(Performance Collapse Zone)

當采樣溫度超出一定范圍時,性能急劇下降。

根據(jù)上圖規(guī)律,Polaris團隊提出以控制探索區(qū)的溫度作為初始化溫度。

實驗顯示,常用的t=0.6或t=1.0的設置溫度過低,限制了模型的探索空間,導致難以挖掘RL潛力。

因此,Polaris把Qwen3-4B的初始訓練溫度設置為1.4。

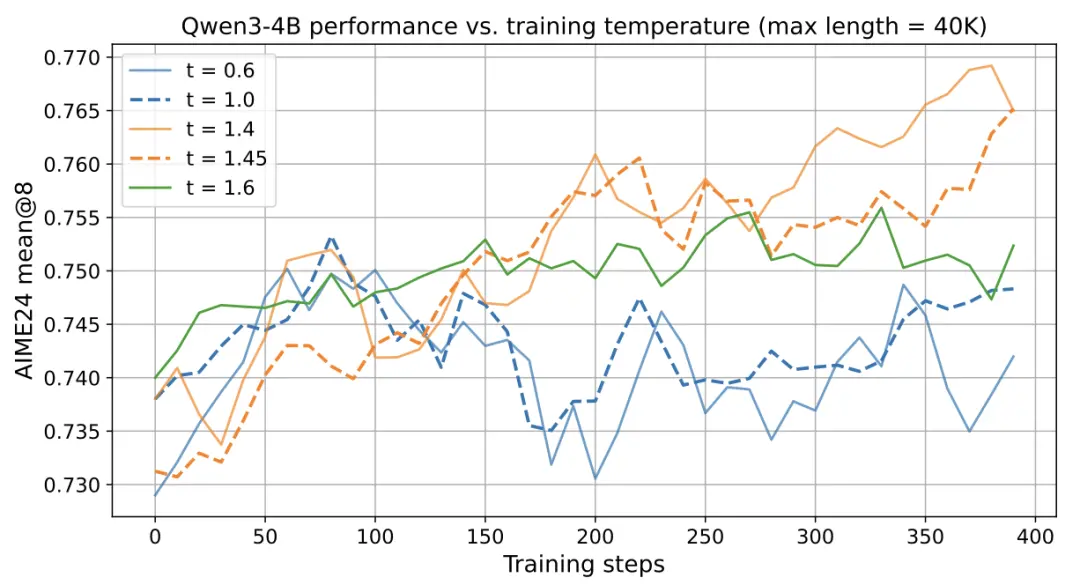

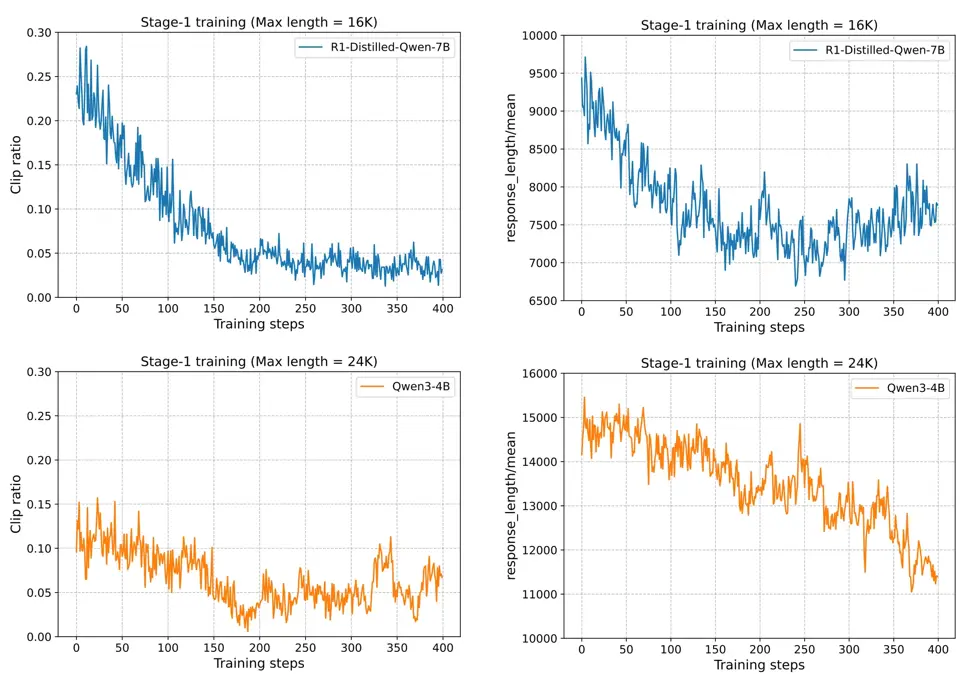

動態(tài)溫度調整

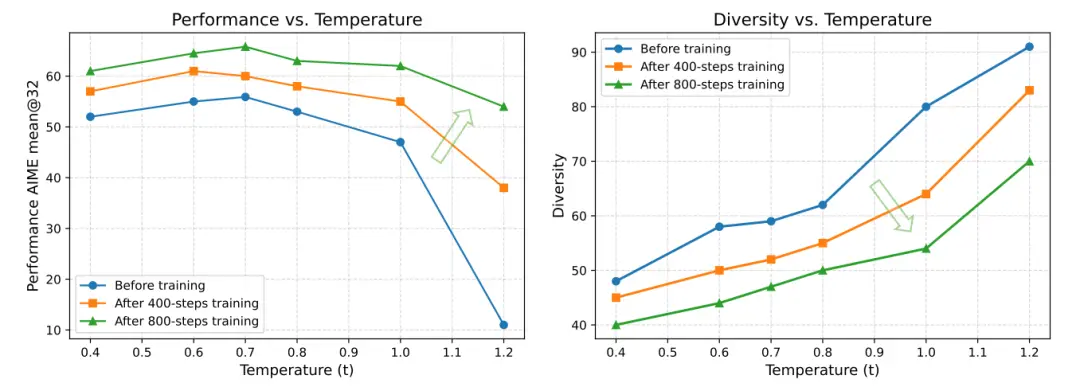

在性能增長的同時,多樣性同樣也會發(fā)生偏移。隨著訓練收斂,各路徑間共享的N-gram比例增加,探索空間也隨之縮小。

在整個訓練過程中始終使用最開始的溫度,會導致訓練后期多樣性不足。

因此,Polaris團隊提出在RL訓練過程中動態(tài)更新采樣溫度的策略:在每個階段開始前都進行和溫度初始化時類似的搜索方法,使得后續(xù)階段起始的多樣性分數(shù)和第一階段的相似。

舉個例子,假如第一階段開始的多樣性分數(shù)是60,那此后的每個階段,Polaris團隊都會選擇一個能把多樣性分數(shù)拉到60的溫度來進行訓練。

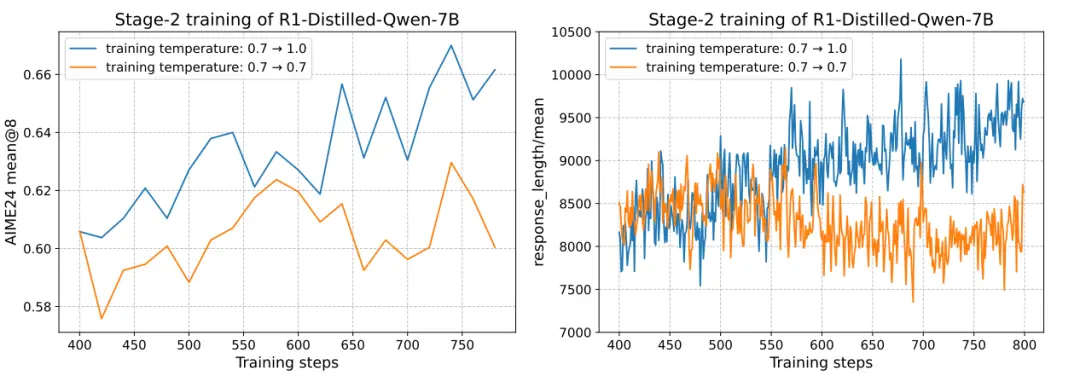

對比實驗的結果顯示,采用同一溫度訓練到結束,其效果不及多階段溫度調整。

多階段溫度調整不僅帶來了更優(yōu)的RL訓練效果,還使得回答長度的提升更加穩(wěn)定。

思維鏈長度外推

在訓練Qwen3-4B的過程中,一個顯著難題在于長上下文訓練,因為模型本身的回答長度就已經(jīng)非常長了,要繼續(xù)訓練的更長需要更高昂的計算代價。

Qwen3-4B的模型預訓練上下文長度僅有32K,而RL階段Polaris將最大訓練長設定為52K。但實際達到最大序列長度的訓練樣本比例不足10%,意味著真正使用長文本進行訓練的樣本非常有限。

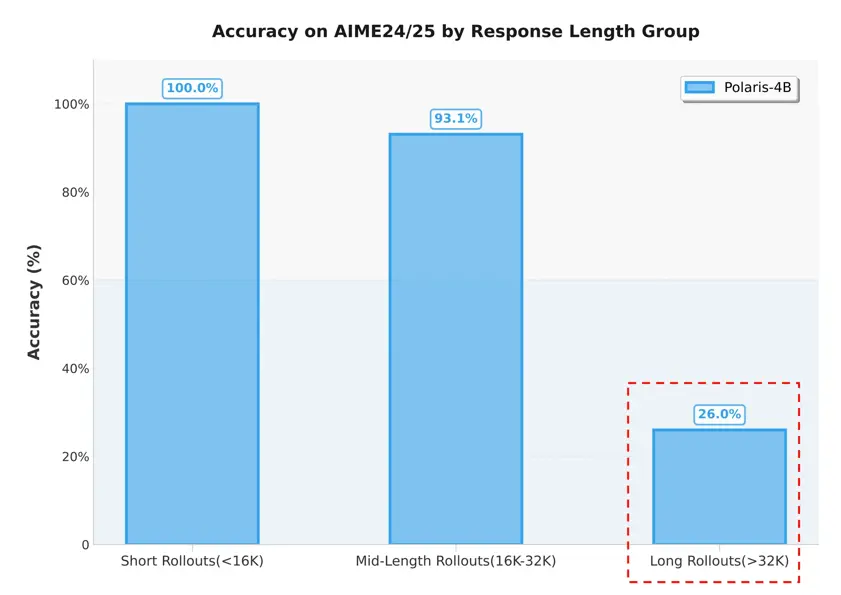

為評估Polaris-4B-Preview的長文生成能力,Polaris究團隊選取了AIME2024/25中的60題,每題進行32次推理,總計1920個樣本,并按照回答長度將其分為三組:

短文本組:回答長度小于16K;

中等文本組:回答長度介于16K到32K;

長文本組:回答長度超過預訓練長度32K。

統(tǒng)計結果表明,長文本組的準確率僅為26%,證明模型在生成超過預訓練長度的長CoT時,性能明顯受限。

既然RL在長上下文長度的時候具備劣勢,那么長CoT性能不佳可能是由于長文本訓練不充分導致。

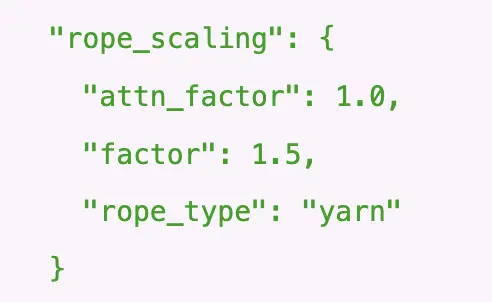

針對長文本訓練樣本不足的問題,團隊引入了長度外推技術。通過位置編碼RoPE的調整,模型能夠在推理時處理超出訓練時所見的更長序列,進而補償長文本訓練中的不足。

具體實現(xiàn)上,研究團隊采用了YaRN作為外推方法,并設置擴展因子為1.5,如下配置所示:

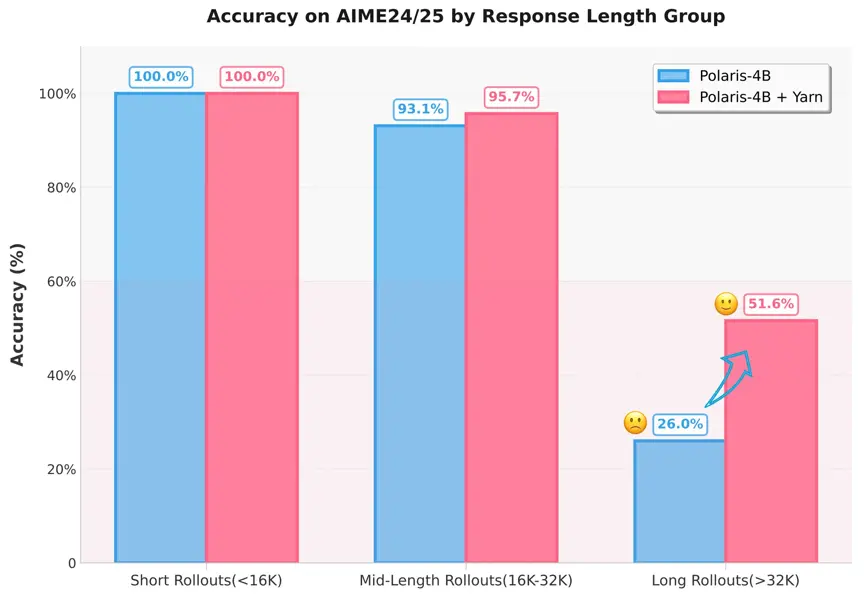

實驗結果顯示,通過應用該策略,超過32K長度回答的準確率由26%提升至超過50%

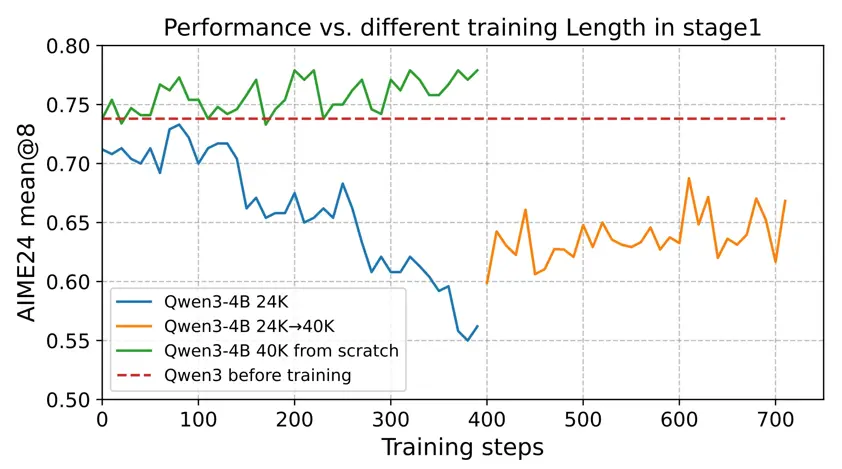

多階段訓練

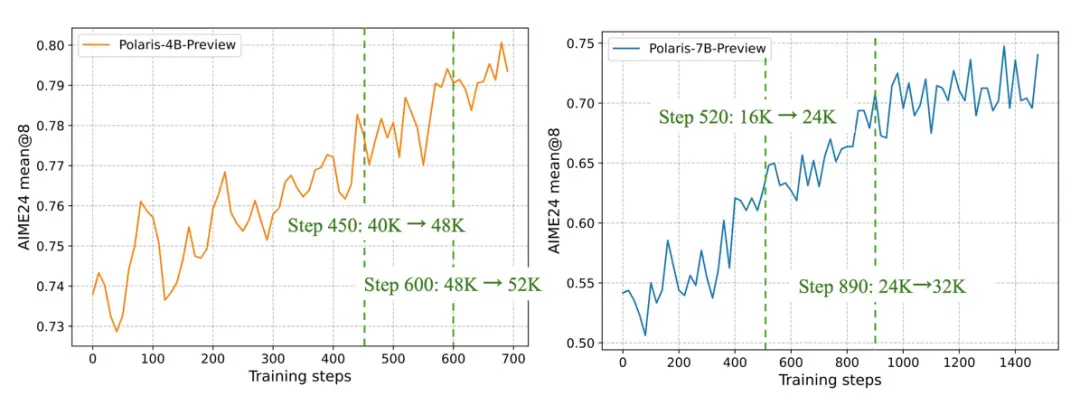

Polaris采用多階段的訓練方式,在早期階段,模型使用較短的上下文窗口;待模型表現(xiàn)收斂后,再逐漸增加上下文窗口的長度以拓寬模型的推理能力。

盡管這一策略在某些模型下有效,但在多階段訓練中,初始階段選擇合適的最大長度至關重要,不同基礎模型token利用效率存在差異。

實驗發(fā)現(xiàn),對于DeepSeek-R1-Distill-Qwen-1.5B/7B,采用較短的響應長度訓練效果都較好;但對Qwen3-4B來說,即使響應長度只有24K且響應截斷比例低于15%,其性能也會急劇下降,這種下降即使在后期階段也難以恢復。

通常來說,從一開始就讓模型“思考更長”會更安全:對于Qwen3-4B,實驗觀察到從零開始使用40K響應長度時性能穩(wěn)步提升,這與從一開始就采用24K和24K→40K的方案形成了鮮明對比。

要點:當計算資源允許時,直接從官方倉庫建議的最大解碼長度開始。

評估結果

Polaris模型需要使用比Qwen3更高的采樣溫度和更長的響應長度;所有其他設置保持相同。

對于AIME24和AIME25,上表報告了32次運行的平均性能。

可以看到,Polaris讓4B模型的數(shù)學推理能力(AIME25上取得79.4,AIME24上取得81.2)超越了一眾商業(yè)大模型,在大多數(shù)評測中表現(xiàn)最佳。