華為這次是真要放大招了。

上海人工智能大會上即將發(fā)布的昇騰384超節(jié)點,384顆NPU+192顆CPU抱團干大事,專門解決大模型訓練時算力堵車的頑疾。

這場算力突圍戰(zhàn)背后,藏著中國科技企業(yè)最硬核的反殺。

看看參數就刺激。

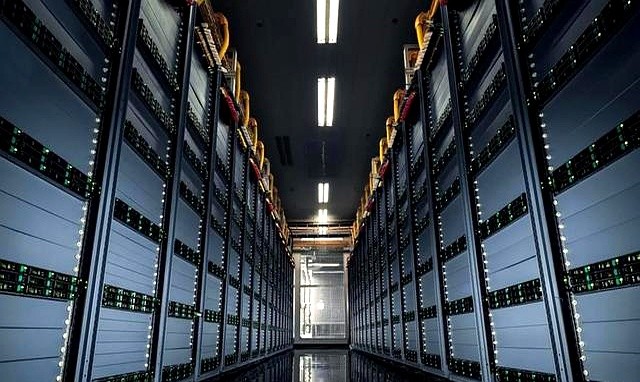

官方透露每臺設備能塞下12000張加速卡,算力密度直接比英偉達DGX SuperPOD高30%。

最狠的是帶寬拉到2.4Tbps,相當于同時傳輸50部4K電影。

這玩意跑通千億參數大模型,訓練時間能壓縮到三天以內,對比去年某互聯網巨頭用英偉達卡搭的集群,效率直接翻倍。

關鍵是能無限堆疊,現在華為廊坊基地已經搞出萬卡級集群,據說單集群日均訓練成本比進口方案低40%。

懂行的都清楚,這波操作其實是逼出來的。

去年美國卡住A100/H100出貨,國內大廠急得跳腳。

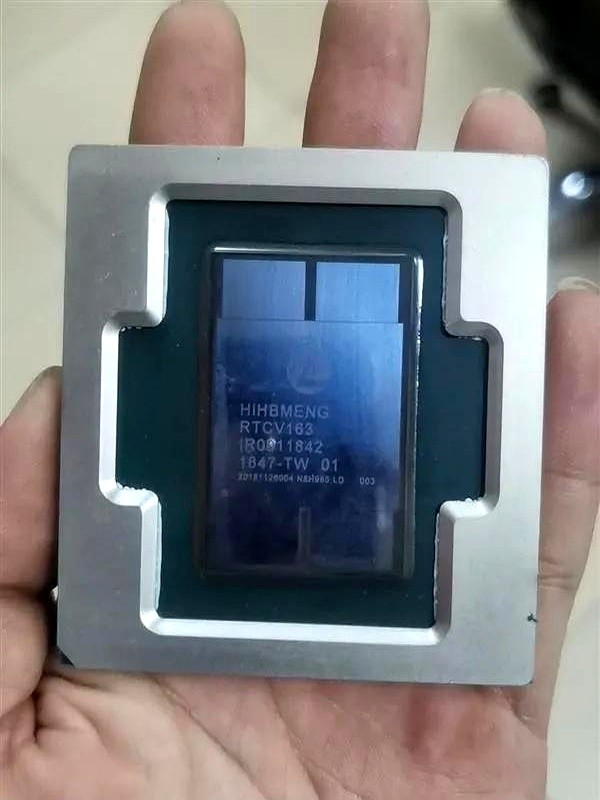

現在昇騰910B實測算力雖然只有H100的75%,但勝在互聯技術牛逼。

華為把自家光通信技術融進去,搞出這個能跨機柜組網的怪物。

業(yè)內流傳某頭部AI公司測試時驚了,用384顆昇騰跑175B參數模型,訓練速度居然比同規(guī)模英偉達集群快15%,數據堵車問題真給解決了。

但別急著沸騰。

現在供應鏈還卡著脖子呢,昇騰芯片用的7nm工藝全靠中芯國際撐著,良率據說才60%。

隔壁英偉達的H20雖然性能閹割,但靠著成熟生態(tài),今年在國內已經賣出20億美元。

華為現在急缺軟件生態(tài),自家MindSpore框架市占率才12%,跑通昇騰集群得專門配算法優(yōu)化團隊,普通企業(yè)根本玩不轉。

最騷的操作在商業(yè)層面。

華為把算力集群當水電賣,搞出個“算力加油站”模式。

鄭州人工智能計算中心已經接單,企業(yè)按模型訓練時長租用,每小時收費比云服務低三成。

這招直接捅破英偉達的利潤護城河,畢竟老黃賣的是鏟子,華為直接開挖金礦的服務。

看客們可能沒注意,這波算力競賽背后藏著大國博弈。

美國剛更新的AI芯片禁令里,特別點名要限制集群規(guī)模。

華為這時候亮劍,明擺著告訴對手:物理封鎖沒用,架構創(chuàng)新照樣破局。

蘇州超算中心的人私下說,他們用昇騰集群跑氣象大模型,原本需要進口設備三個月才能搞定的預測任務,現在二十天就能交差。

當然也別神話華為。

實測中發(fā)現跑某些Transformer模型時,昇騰的顯存帶寬還是瓶頸。

業(yè)內都在等下一代芯片,聽說已經在測試12nm工藝,內存容量打算翻倍。

現在最現實的問題是,國內互聯網大廠到底會不會真金白銀支持?

百度去年買了上萬張昇騰卡,但核心業(yè)務還是用著庫存的A800。